汽车的自动驾驶技术已经取得了重大进展。原因之一是高精度GPS和信息通信的高速化(5G、6G以及更高速度的技术)等信息环境基础设施的完善,此外车载摄像头和传感器技术的改进也做出了重要贡献。

其中,自动驾驶必不可少的技术之一便是精确掌握周围信息。LiDAR、雷达和超声波等传感器是知晓物体是否存在的方法,但要弄清是什么物体,就需要使用相机。

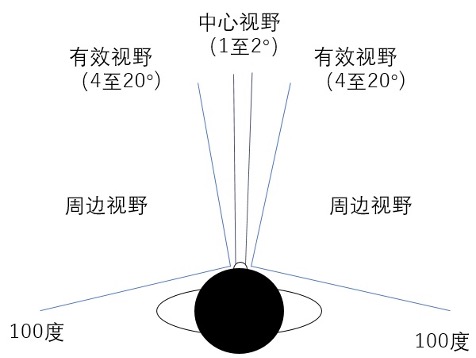

如今的汽车在不同位置均配备有传感器和相机。例如,某品牌的3级自动驾驶汽车由于不是完全自动驾驶(5级),因而未采用LiDAR,但仍有四个360°相机和一个热成像相机。收集该车辆的周围信息是一个高速处理过程,首先使用相机确定物体位置,然后用传感器测量与该物体(人、其他车辆、树木、建筑物、障碍物等)的距离。相机相当于司机的眼睛,但是,当人类专注于一个点时,只能识别这一处的信息。例如在2米远处用55英寸的电视看电影。此时屏幕两个边缘之间的视野角度大约为横向17°,纵向10°。在阅读字幕时,很难掌握字幕以外的屏幕上发生的事情。而且,据说人类的视野范围约为横向200°,纵向125°,能够迅速稳定进行观察的稳定注视视野为横向60至90°,纵向约45至70°,注视某一点时的中心视野为1至2°。

驾驶车辆时也是如此。如果把注意力集中在车门后视镜上,将无法掌握那一刻的车辆前后方情况。自动驾驶可以同时掌握全方位的情况,从而将事故概率降到极低(当然,目标是零事故)。

由使用深度学习方法的人工智能来识别相机拍摄的物体。这属于软件的范畴,但在相机拍摄角内往往会产生较大的亮度差异。也就是明亮区域和黑暗区域的混合状态。

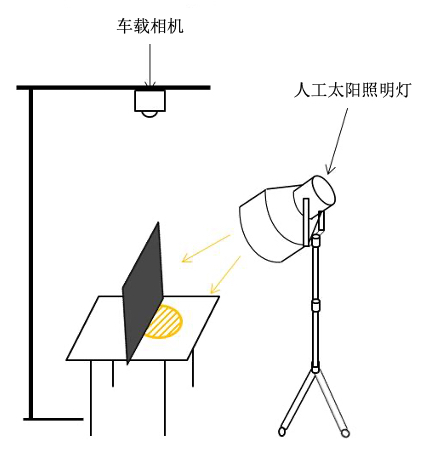

如果快门速度恰巧在明亮区域曝光,黑暗区域将是漆黑一片,看起来什么也没有。这被称为“死黑”。相反,如果快门速度在黑暗区域曝光,则明亮区域便会变成全白。这被称为“死白”。在这种状态下,车辆将无法识别物体。听说前段时间发生过一起事故,汽车在倒车时,倒车显示屏进入死黑状态,导致司机没有注意到有幼童在玩耍,不幸撞到该儿童。为了防止此类事故发生,在自动驾驶或ADAS中,也安装一种可在明暗混合状态下减弱死白区域,扩大死黑区域以便识别物体的软件。人工太阳照明灯是该软件开发的一个重要组成部分。

上图是在相机拍摄角内人工制造明暗混合状态的示例图。在开发将物体放置于明亮区域和黑暗区域,减轻拍摄画面对比度的软件时,会用到人工太阳照明灯。

如果想在这种光照环境下评估车载摄像头,或者进行软件定量评估,XG-500AFSS人工太阳照明灯是最佳选择。

关于产品的规格和性能,请参考以下页面。

如果您想在稳定的环境中评估车载摄像头的性能或者开发图像处理软件,请随时联系本公司经验丰富的工作人员。我们将根据客户的要求提供装置方案建议。

▼SERIC XELIOS 超级聚焦型(聚光型)

https://seric-xelios.cn/product/superspot.html